Файл robots.txt позволяет указать, какие страницы вашего портала документации будут индексироваться и отображаться в поисковых системах. Например, если вы используете портал Документерры для создания контекстной справки, имеет смысл скрыть страницы с таким контентом от поисковых систем.

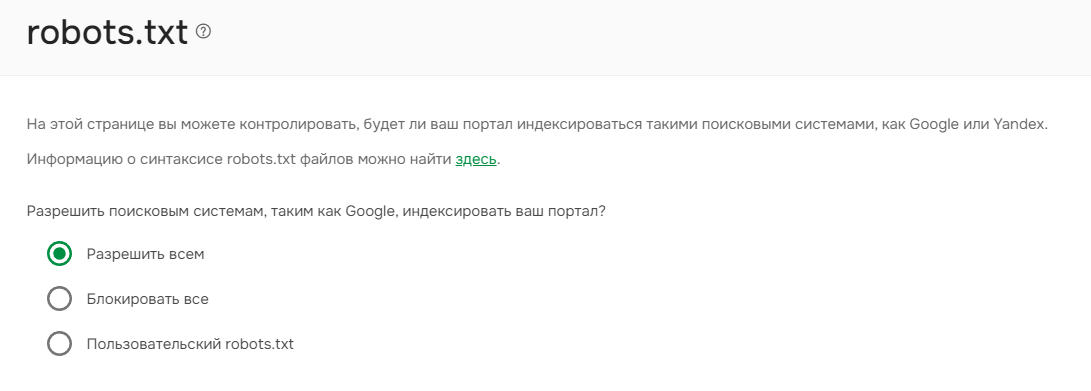

Чтобы настроить файл robots.txt, перейдите в Настройки → Поиск контента → Robots.txt.

Как видно на скриншоте выше, вы можете разрешить поисковым системам индексировать все страницы вашего портала или запретить индексацию всего портала.

Третья опция, называемая Пользовательский robots.txt, позволяет вручную указать страницы, которые вы не хотите индексировать. Например, с помощью этой опции можно скрыть от поисковых систем определённые страницы справки:

Code |

User-agent: * Disallow: /articles/my-project/my-hidden-topic |

Подробнее о синтаксисе файла robots.txt можно узнать здесь: Robots.txt. Введение и руководство.